「コンピュータが人間よりも賢くなったら何が起こるのか?」という問題は、コンピュータの登場以来、たびたび取り上げられてきました。今から50年以上前の1968年に作られた映画『2001年宇宙の旅』や、『「ウルトラセブン』シリーズの『第四惑星の悪夢』でも、これが主題となっています。また、人間を超える能力を持つに至ったアンドロイドやロボットが人間に反乱を起こす物語も、1982年の映画『ブレードランナー』や2003年の浦沢直樹氏の漫画『PLUTO』など、数多くあります。

シンギュラリティ、雇用、格差問題

近年、AI(人工知能)の進歩とともに、この問題は一段と注目されるようになっています。その背景としては、いくつかの要因が挙げられます。

まず、「シンギュラリティ」という言葉の広まりです。もともとシンギュラリティは数学や物理学で「特異点」を指す言葉ですが、これが、「AIの能力が人間を超え、AI自身がさらに優れたAIを作り出すようになり、後戻りできない状況になること」を意味する言葉として用いられるようになりました。そして、「2045年にはそのような状況になる」という予言も話題を集めました。

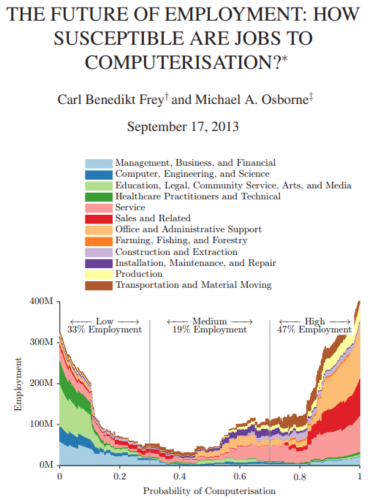

次に、「AIが人間の職を奪うのではないか」との懸念の広がりです。2013年にオックスフォード大学のフレイ氏とオズボーン氏が発表した論文の中で、「米国で10~20年以内に労働人口の47%が機械に代替されるリスクは70%以上」という推計結果が示されました。この推計は実際にはかなり大まかなものですが、職を奪われることへの人々の警戒感を醸成するには十分でした。

Frey and Osborne <2013>の有名な分析 ©️Frey and Osborne

©️Frey and Osborne

さらに、デジタル化と並行して、世界的に格差問題への関心が高まっていることも挙げられます。この中で、AIが相対的に貧しい人々の職を奪ったり、AIが限られた人々によって使われ、この人々に一段と冨を集中させないかといった懸念も生じています。いわゆる「ベーシックインカム」の議論も、このような懸念に根差しています。

加えて、戦場でAIを搭載したドローンが実際に兵器として使われたというニュースも、AIが軍事目的に使われることへの警戒感を高めることになりました。

「AI規制」への関心の高まり

AIを巡る各国当局の関心も高まっています。

欧州委員会は本年4月21日に、AIの規制法案を公表しました。これは、AIをその利用のリスクに応じて分類し、リスクが高いAIほど実用に際し厳格な手続きを設けた上で、きわめてリスクの高いAIの使い方については禁止することを企図したものです。また報道によれば、中国は現在、アルゴリズムの特定の目的への利用を制限する規制を検討中とされています。 欧州委員会の取り組みは、AIがもたらす便益を享受しつつ、その害をなるべく小さくすることを目指しているわけですが、この規制自体、そもそも容易ではありません。さらに最近では、そもそも人間より賢いAIを作り出せないようにすべきではないか、といった主張すら聞かれます。

欧州委員会の取り組みは、AIがもたらす便益を享受しつつ、その害をなるべく小さくすることを目指しているわけですが、この規制自体、そもそも容易ではありません。さらに最近では、そもそも人間より賢いAIを作り出せないようにすべきではないか、といった主張すら聞かれます。

AIの機能そのものを規制することの難しさ

しかし、AIの機能そのものを規制することは、技術的にも制度的にも容易ではありませんし、むしろ悪い帰結をもたらす可能性もあります。

近年のAIの急速な発展を支えているディープラーニング(深層学習)は、データの学習を通じてAIが賢くなっていくことを前提としています。「AIを賢くしない」ということは、「良いデータを与えない」ということであり、そのことがむしろ「悪いAI」を作ってしまう可能性もあります。すなわち、「AIを人間を脅かさない程度に賢くする」ことは、簡単ではありません。

また、「より良いAIを作りたい」というのは、科学者や技術者の本質的な欲求です。さらに、モノと違ってコンセプトは容易に国境を超えます。したがって、「AIの機能そのものを規制する」ことを考えるならば、世界中の国々が参加しなければ実効的になりません(さもないと、優秀なAI技術者は規制の緩い国に行ってしまうでしょう)。

ダイナマイトが兵器として使われたのは、ダイナマイトのせいではなく、人間のせいであり、だからこそ、ノーベルは科学の発展と人類への貢献を祈念してノーベル賞を作ったわけです。これは、AIでも同じでしょう。科学技術そのものを止めるのではなく、その「悪い使い方」に歯止めをかけるのが、人間の知恵の見せ所だと思います。

世界は「賢さ」を必要としている

人々が今直面しているチャレンジは、まだまだ「賢い知能」を求めています。

COVID-19のような新たな感染症の脅威は、その典型です。今回の光明は、有効なワクチンが過去に例を見ない速さで開発されたことです。その大きな要因の一つも、AIの進歩でした。

一方で、COVID-19を巡る対応はさまざまな困難に直面しました。例えば、個々のニーズをくみ上げることの難しさを反映し「一律」にならざるを得なかった給付金やマスクなどの配布、医療リソースが逼迫する中でのリソースの効率的配分などです。これらの課題はまさに、我々がもっと賢くならなければいけないことを示しています。「AIをあまり賢くしないように」などと考える余裕は当分なさそうです。

さらに、カーボンニュートラルや脱炭素化も、経済主体が飛躍的に賢くならないと、実現は困難です。資源配分をリスクとリターンだけで決めるのではなく、他国や将来世代への影響も含めた複雑なファクターを全て勘案して決めなければいけないからです。このチャレンジを克服できなければ、カーボンニュートラルは結局は実現できないか、あるいは統制経済化の道を辿ってしまいます。

AIとともに賢くなる

このように考えると、唯一の選択肢は、AIを使う人間もAIとともに賢くなることだと思います。

自転車や自動車を発明した時点で、人間は既に自分たちよりも速く走れる機械を手に入れました。そのことは交通事故のリスクを新たに生み出しましたが、人間は技術の導入に合わせて、交通法規の整備などを通じてリスクを最小化し、便益を最大化するよう努めてきました。

コンピュータも、すでにその計算能力は多くの分野で人間を超えていますが、これまでのところ、人間側の対応もあって、その多くは人間の暮らしをより良くする方向に貢献しています。この中で、AIがもたらす新たな論点は、AIがさらに進化して、人間のような「意志」を持つようになるのかという点でしょう。

2016年、マイクロソフトのAI「Tay(テイ)」が、悪意あるユーザーが学習させたデータによって、差別的な発言を繰り返すようになった事件がありました。このように、人間側のデータの与え方がAIを決めるということは、今後、AIが「意志」を持つとすれば、その意志のあり方は、結局は人間が決めるとも言えます。したがって重要なことは、人間の側がAIの仕組みを十分に理解しながら、倫理観を持って開発していくこと、そして、AIに対応した法律や制度の整備を進めていくことだと思います。

もちろん、これは容易なことではありません。しかし、AIの進歩は、これに合わせて人間が思考を広げるチャンスでもあります。AIとともに人間も賢くなるよう努めていくことが、両者が共存する鍵になるでしょう。

連載第60回「中央銀行デジタル通貨のあるべき姿」(11月10日掲載予定)